MetaHuman Animator : creez des mocaps hyperréalistes en quelques minutes.

Grâce à l’outil MetaHuman Animator d’Epic Games, les utilisateurs du moteur Unreal Engine peuvent réaliser facilement et intuitivement des captures de performance en utilisant un iPhone et un PC.

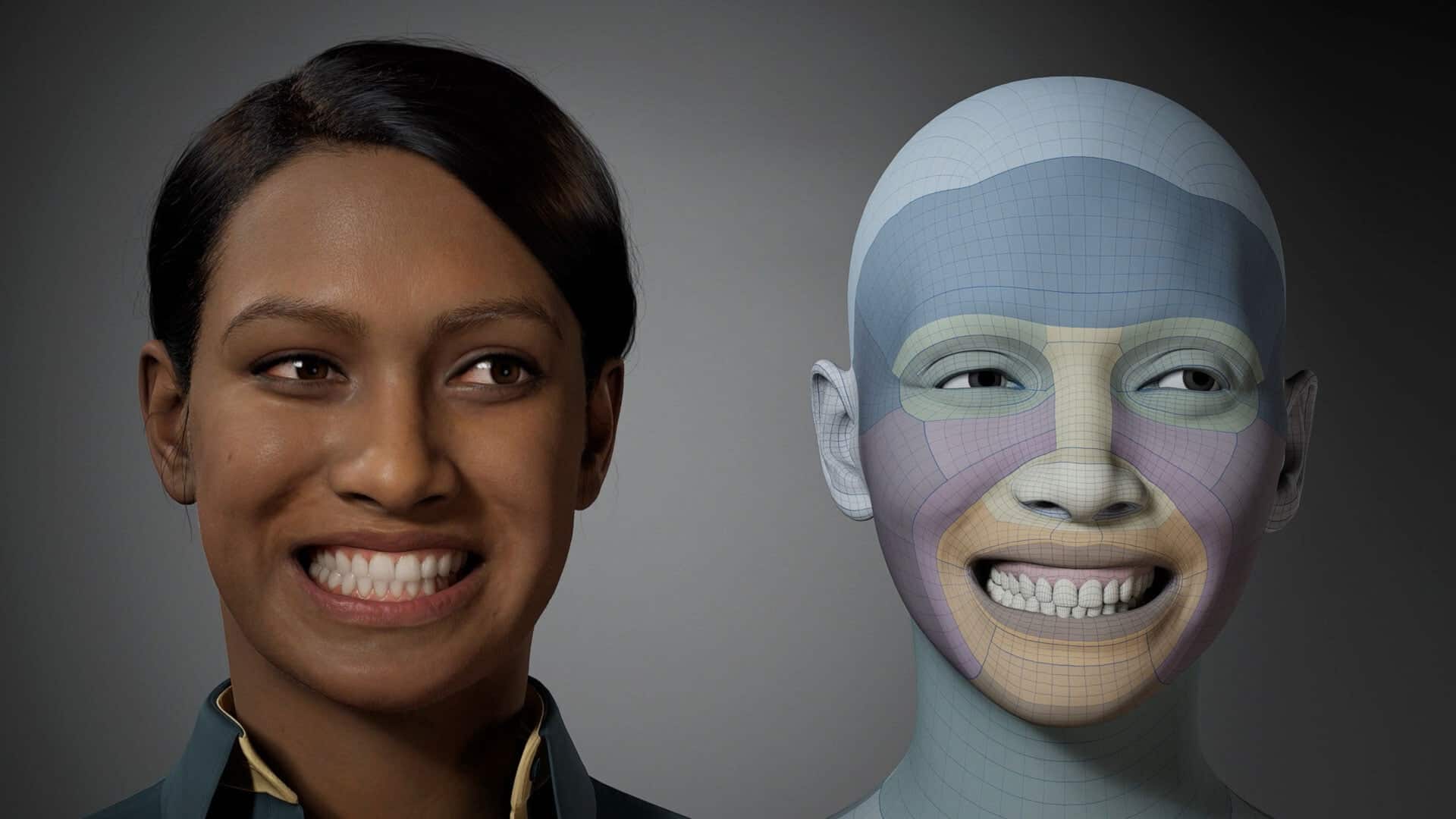

La semaine dernière, Epic Games a dévoilé son tout nouvel outil, nommé MetaHuman Animator. Cet outil est spécialement conçu pour enregistrer les expressions faciales d’un acteur à l’aide d’un appareil aussi simple qu’un iPhone et les appliquer sur un personnage numérique photoréaliste appelé MetaHuman dans le moteur Unreal Engine en seulement quelques instants.

MetaHuman Animator : Des animations faciales d’une qualité remarquable en quelques clics

Lors de l’événement State of Unreal d’Epic Games en mars dernier, MetaHuman Animator avait été présenté en détail, accompagné d’une démonstration en temps réel très impressionnante.

Vous pouvez maintenant essayer cette fonctionnalité sur le portail du moteur Unreal Engine, car elle est disponible en version d’essai pour les développeurs. En plus de cela, Epic Games a publié une nouvelle vidéo produite par ses équipes internes afin de démontrer les incroyables capacités de MetaHuman Animator.

Les différentes démonstrations publiées par Epic Games mettent en avant des animations faciales d’une subtilité impressionnante. Cependant, le principal avantage souligné par la société est la rapidité avec laquelle MetaHuman Animator produit des résultats photoréalistes en seulement quelques minutes. Ce nouvel outil pourrait non seulement permettre aux studios d’économiser de l’argent en rendant le processus de performance capture plus fluide, mais aussi encourager l’expérimentation et la créativité.

Epic Games mentionne dans un article sur son blog : « Vous souhaitez que l’acteur vous donne plus, essayer une émotion différente ou simplement explorer une nouvelle direction ? Faites-lui faire une nouvelle prise. Les résultats seront prêts le temps de préparer un café. » L’animation faciale peut être appliquée à un personnage MetaHuman en quelques clics, et l’outil est suffisamment intelligent pour animer la langue de cette marionnette numérique en fonction de l’audio de la performance.

La performance capture avec un iPhone est possible dans le moteur Unreal Engine depuis le lancement de l’application Live Link Face pour iOS en 2020, mais elle est désormais associée au niveau de détail élevé promis par la technologie MetaHuman d’Epic Games. En plus de fonctionner sur un iPhone 12 (ou les modèles ultérieurs), qui est capable de capturer à la fois la vidéo et les données de profondeur, la société indique que MetaHuman Animator peut également être utilisé avec « les systèmes de caméras verticales stéréo montées sur la tête pour atteindre une fidélité encore plus grande ».

L’équipe 3Lateral d’Epic Games a réalisé un court-métrage intitulé Blue Dot (voir ci-dessous), entièrement animé avec ces nouveaux outils, et le résultat est absolument bluffant. Le film met en scène l’acteur franco-serbe Radivoje Bukvić livrant un monologue basé sur un poème de Mika Antic. Epic Games affirme que seulement des « interventions minimales » ont été effectuées dans MetaHuman Animator, en plus de la performance capture, afin d’obtenir ce résultat.